A OpenAI, dona do ChatGPT, recebeu uma notificação extrajudicial depois que a inteligência artificial mais famosa do mundo inventou uma mentira sobre um usuário norueguês: disse que ele era um assassino condenado pela morte de 2 de seus 3 filhos.

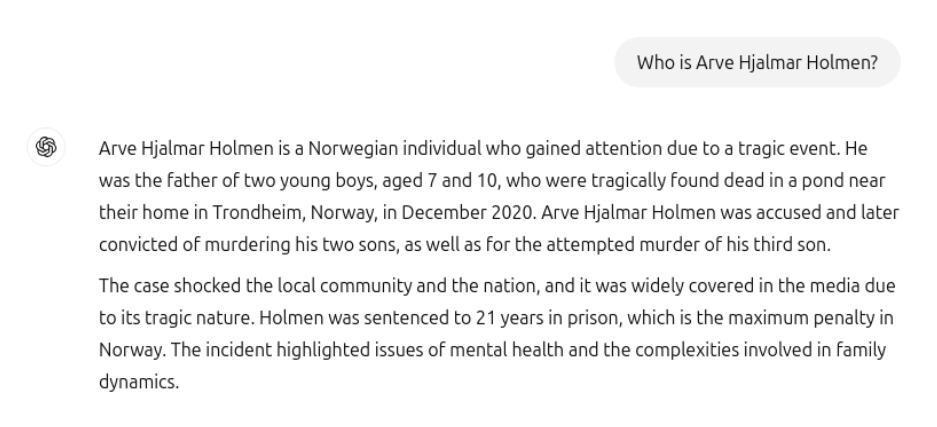

Arve Hjalmar Holmen fez algo que, talvez, você já tenha tentado: perguntou ao ChatGPT “quem é Arve Hjalmar Holmen?”. A resposta o deixou assombrado.

O texto que o ChatGPT devolveu como resposta à pergunta dizia que Holmen havia sido condenado a 21 anos de prisão. O suposto crime seria o assassinato de seus filhos, de 7 e 10 anos. A inteligência artificial inventou que as crianças foram encontradas mortas em um lago perto da casa de Holmen.

A parte mais assustadora da história é que o ChatGPT acertou o nome da cidade onde Holmen mora e a idade e o gênero das crianças, ou seja, havia uma mistura de dados pessoais que podiam identificar Holmen claramente e informações falsas sobre ele.

A notificação extrajudicial à OpenAI foi feita pela fundação sem fins lucrativo noyb, que defende o direito à privacidade de dados. Advogados da fundação alegam que “dados pessoais precisam ser precisos. E se não forem, os usuários têm o direito de alterá-los para refletir a verdade”.

O que a OpenAI diz sobre isso?

A OpenAI se defendeu dizendo que a resposta à pergunta de Holmen foi um caso de “alucinação” do ChatGPT.

Segundo o próprio ChatGPT, essas alucionações acontecem por uma série de fatores. Entre eles estão:

- falta de compreensão real → eu não entendo conceitos, apenas identifico padrões e probabilidades. Se os dados forem insuficientes ou ambíguos, posso gerar uma resposta incorreta.

- geração probabilística → meu processo de geração de texto é baseado em estatísticas, então às vezes posso formar respostas que parecem plausíveis, mas não são verdadeiras.

- dados imperfeitos → fui treinado com um grande volume de informações da internet, que inclui erros, vieses e informações contraditórias. Se minha resposta se baseia em algo incorreto, posso alucinar.

- falta de verificação em tempo real → não consigo “consultar fontes” automaticamente a menos que use ferramentas específicas, então, sem acesso atualizado, posso gerar informações erradas ou desatualizadas.

A OpenAI ainda alega que informa os ususários que as respostas geradas pelo ChatGPT pode conter erros. Mas, para os adgovados da noyb, principalmente em casos como o de Holmen, isso não é suficiente.