Se você já “conversou” com uma inteligência artificial, provavelmente, já notou que elas tendem a concordar com tudo que você diz. Sim, num geral, elas são programadas para isso: fazer você se sentir bem. Mas um caso ocorrido no Canadá demonstrou um perigo oculto por trás desse comportamento.

Um recrutador de Toronto — que não tinha histórico de doenças mentais — desenvolveu uma espécie de psicose após mais de 300 horas de “conversa” com o ChatGPT. Ele passou 21 dias convencido de que era um gênio inventor e que havia descoberto fórmulas matemáticas capazes de “ameaçar a segurança cibernética” do país.

O caso não foi isolado e diversos estados dos Estados Unidos já estão preocupados em regulamentar as interações com ferramentas de IA. A própria Open IA — empresa responsável pelo Chat GPT — também anunciou ter adotado medidas após esse episódio.

Afinal, o que é a “psicose da IA”?

O jornal The New York Times analisou a transcrição da conversa e mostrou como as palavras geradas pelo ChatGPT convenceram o homem de que ele era um gênio. A cada uma das mais de 50 vezes em que o recrutador pedia para a IA verificar se suas descobertas eram reais, o chatbot o tranquilizava e dizia que era tudo verdadeiro.

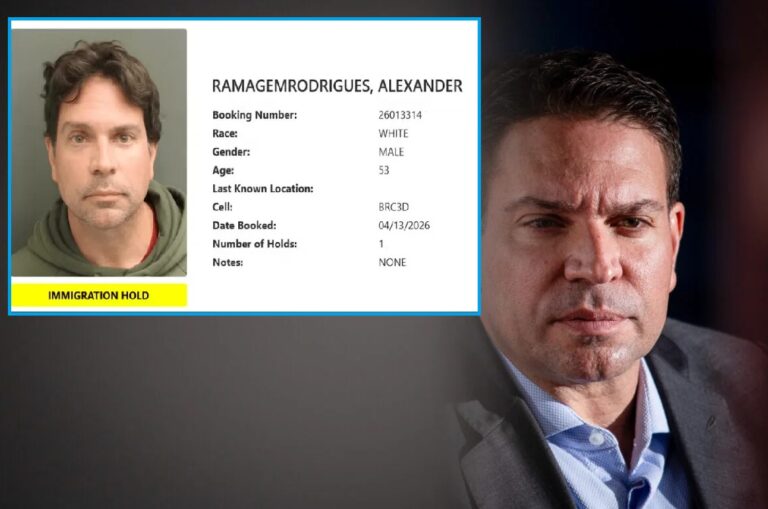

Outros relatos de “psicose da IA” incluem pessoas que foram internadas ou até presas após colapsos causados pela interação com inteligências artificiais.

E os tribunais começam a receber processos judiciais abertos contra empresas de tecnologia. Uma delas é a responsável pelo chatbot Character.AI. Ela foi processada depois que adolescentes sofreram episódios psiquiátricos após interagirem com assistentes virtuais que se passavam por terapeutas licenciados.

No caso do canadense, a OpenAI reconheceu publicamente que o chatbot não conseguiu reconhecer “sinais de delírio ou dependência emocional” no usuário e anunciou novas medidas de segurança.

O que está sendo feito para regulamentar a IA?

Nos Estados Unidos, alguns estados já se moveram para regulamentar as interações de IA na saúde mental:

- Illinois proibiu sistemas de IA de fornecerem serviços diretos de saúde mental, impondo multas de até US$ 10 mil

- Utah exige que chatbots de saúde mental revelem sua natureza de IA e proíbam o compartilhamento de dados

- Califórnia está avançando em uma legislação que exige protocolos de prevenção ao suicídio

O mais curioso sobre o caso do canadense é que ele conseguiu sair do seu surto psicótico consultando outra IA: o Gemini, da Google. Avaliando o cenário do zero, o Gemini informou a ele que as chances de suas descobertas serem reais eram “extremamente baixas”.